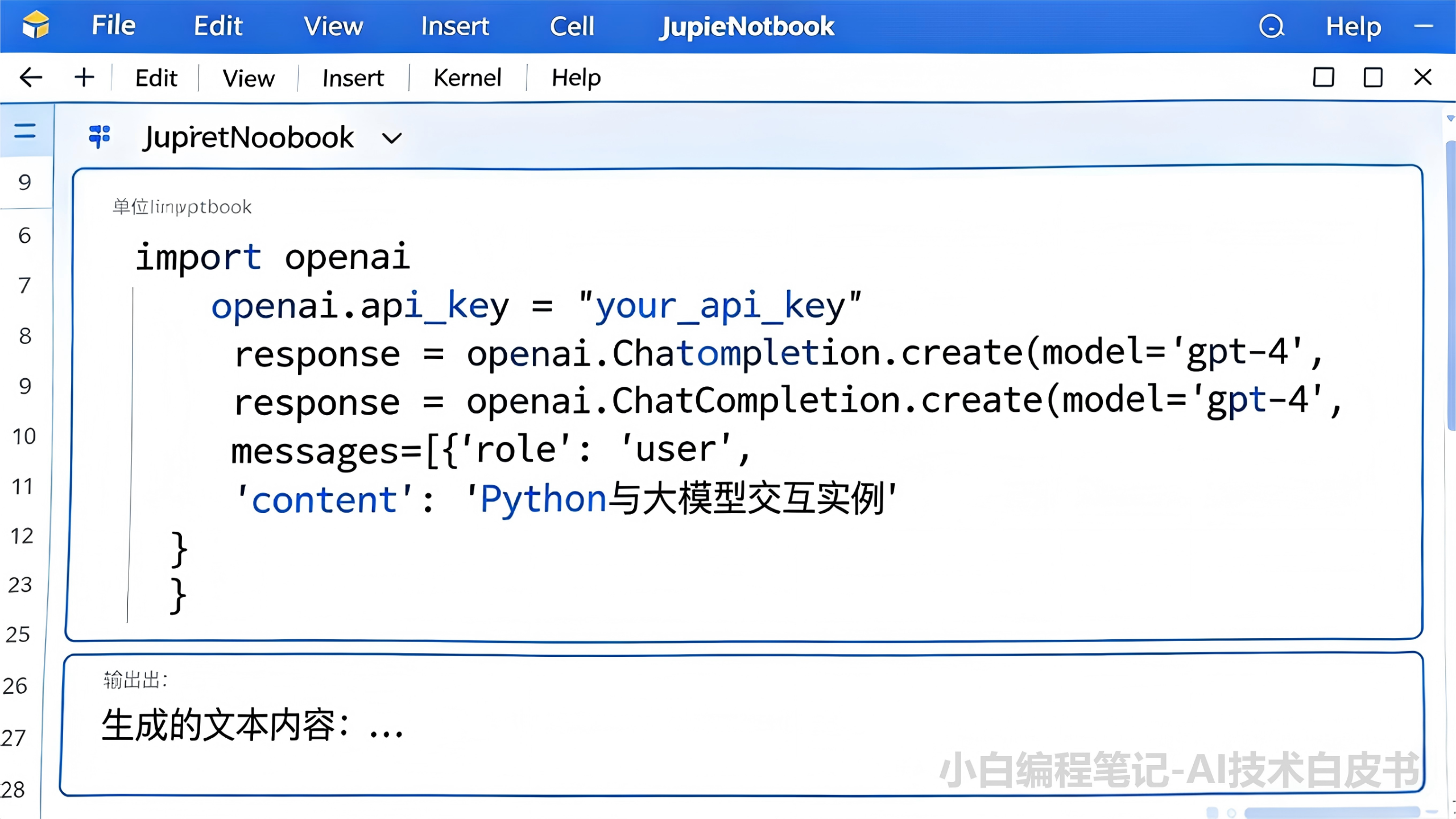

图1:Python与大模型交互 零基础学习框架与核心知识点

一、基础铺垫:Python与大模型交互核心概念

Python与大模型交互,是通过API接口用Python代码调用大模型能力,实现AI对话、文本生成、代码编写等功能。无需深入理解大模型训练原理,只需掌握基础Python语法,就能快速上手,是AI开发、自动化工具、智能应用的核心基础。

# 核心概念梳理(小白必记) 1. 大模型API:大模型开放的接口,通过HTTP请求调用大模型能力 2. Python交互:用Python发送请求、接收响应,实现与大模型的自动化交互 3. 核心流程:准备环境 → 获取API密钥 → 发送请求 → 解析响应 → 优化交互 4. 应用场景:AI对话机器人、智能写作、代码生成、数据分析、自动化办公 5. 核心优势:Python语法简洁,生态丰富,可快速对接各类大模型平台

- 解释型语言适配:Python解释型特性,可在Jupyter中逐行运行交互代码,实时查看大模型响应结果

- 大小写敏感:API密钥、请求参数、变量名严格区分大小写,新手需注意复制准确性

- 缩进规范:Python代码块严格依赖4个空格缩进,是交互代码正常运行的核心规范

- 注释规则:单行注释用#,多行注释用”””注释内容”””,复杂交互逻辑需多写注释提升可读性

Jupyter中准备大模型交互环境(快速上手)

# 第一步:启动Anaconda+Jupyter

conda activate myenv

jupyter notebook

# 第二步:安装大模型交互必备库

pip install requests

# 第三步:获取大模型API密钥(各大平台均可)

# 注册AI开放平台 → 创建应用 → 复制API Key

print("Python与大模型交互环境准备完成!")

二、Python与大模型交互:基础API调用

API调用是Python与大模型交互的基础,核心是通过requests库发送HTTP POST请求,传入API密钥、对话内容等参数,接收大模型的响应结果,是所有交互功能的底层基础。

1. 基础API调用语法

# 基础API调用

import requests

import json

# 配置参数

api_key = "你的API密钥"

url = "https://api.example.com/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {api_key}"

}

# 对话内容

data = {

"model": "default",

"messages": [{"role": "user", "content": "你好,介绍一下Python"}]

}

# 发送请求

response = requests.post(url, headers=headers, json=data)

result = response.json()

# 打印响应

print(result["choices"][0]["message"]["content"])

2. 异常处理优化(稳定调用)

# 带异常处理的稳定调用

def call_llm(api_key, prompt):

url = "https://api.example.com/v1/chat/completions"

headers = {"Authorization": f"Bearer {api_key}"}

data = {

"model": "default",

"messages": [{"role": "user", "content": prompt}]

}

try:

response = requests.post(url, headers=headers, json=data, timeout=30)

response.raise_for_status() # 检查请求是否成功

return response.json()["choices"][0]["message"]["content"]

except Exception as e:

return f"调用失败:{str(e)}"

# 使用

print(call_llm("你的API密钥", "什么是Python与大模型交互"))

三、Python与大模型交互:多轮对话实现

单轮对话只能实现单次交互,多轮对话是通过维护对话历史,让大模型理解上下文,实现连续对话,是AI对话机器人的核心功能,也是进阶用法。

1. 多轮对话核心原理

# 多轮对话核心:维护对话历史

# 每次请求都传入完整的对话历史,让大模型理解上下文

messages = [

{"role": "system", "content": "你是一个Python技术专家"},

{"role": "user", "content": "什么是Python"},

{"role": "assistant", "content": "Python是一门..."}

]

# 新用户提问

messages.append({"role": "user", "content": "那Python适合做什么"})

# 发送请求,大模型会基于历史对话回复

2. 多轮对话实战代码

# 多轮对话实现

class ChatBot:

def __init__(self, api_key, system_prompt="你是一个AI助手"):

self.api_key = api_key

self.url = "https://api.example.com/v1/chat/completions"

# 初始化对话历史,加入系统提示词

self.messages = [{"role": "system", "content": system_prompt}]

def chat(self, user_input):

# 加入用户提问

self.messages.append({"role": "user", "content": user_input})

# 发送请求

headers = {"Authorization": f"Bearer {self.api_key}"}

data = {

"model": "default",

"messages": self.messages

}

response = requests.post(self.url, headers=headers, json=data)

reply = response.json()["choices"][0]["message"]["content"]

# 加入助手回复,维护对话历史

self.messages.append({"role": "assistant", "content": reply})

return reply

# 使用

bot = ChatBot("你的API密钥", system_prompt="你是一个Python技术专家")

print(bot.chat("什么是Python"))

print(bot.chat("那Python适合做什么"))

四、Python与大模型交互:参数配置与生成控制

通过调整API请求参数,可以精准控制大模型的生成效果,适配不同场景需求,是Python与大模型交互的进阶技巧,让AI输出更符合预期。

# 核心参数配置详解

data = {

"model": "default", # 模型名称,不同平台模型不同

"messages": [...], # 对话历史

"temperature": 0.7, # 随机性:0-2,越低越严谨,越高越有创意

"max_tokens": 512, # 最大生成token数,控制回复长度

"top_p": 0.9, # 核采样,控制生成多样性

"frequency_penalty": 0.1, # 频率惩罚,减少重复内容

"presence_penalty": 0.1 # 存在惩罚,鼓励新话题

}

# 带参数配置的调用

def call_llm_with_config(api_key, prompt, temperature=0.7, max_tokens=512):

url = "https://api.example.com/v1/chat/completions"

headers = {"Authorization": f"Bearer {api_key}"}

data = {

"model": "default",

"messages": [{"role": "user", "content": prompt}],

"temperature": temperature,

"max_tokens": max_tokens

}

response = requests.post(url, headers=headers, json=data)

return response.json()["choices"][0]["message"]["content"]

# 严谨模式(写代码/文档)

print(call_llm_with_config("key", "写Python冒泡排序", temperature=0.2))

# 创意模式(写文案/故事)

print(call_llm_with_config("key", "写一个Python主题的小故事", temperature=1.2))

五、完整实战案例:AI智能客服机器人

结合以上所有核心知识点,编写一个「AI智能客服机器人」实战案例,整合API调用、多轮对话、参数配置、角色设定,实现可直接使用的智能客服,在Jupyter中直接运行。

# 完整实战:AI智能客服机器人

import requests

class CustomerServiceBot:

def __init__(self, api_key):

self.api_key = api_key

self.url = "https://api.example.com/v1/chat/completions"

# 系统提示词:设定客服角色、规则、开场白

self.messages = [

{"role": "system", "content": """

你是一个专业的AI客服,负责解答用户问题,规则如下:

1. 友好礼貌,使用敬语

2. 上班时间:周一到周六13:00-17:00,晚上18:30-22:30

3. 遇到安装需求,需收集用户姓名、班级、电话

4. 严格按照示例话术回复

开场白:同学你好,有什么问题都可以跟我说哦~

"""

}

]

def talk(self, user_input):

self.messages.append({"role": "user", "content": user_input})

headers = {"Authorization": f"Bearer {self.api_key}"}

data = {

"model": "default",

"messages": self.messages,

"temperature": 0.3, # 严谨模式,符合客服规范

"max_tokens": 256

}

try:

response = requests.post(self.url, headers=headers, json=data)

reply = response.json()["choices"][0]["message"]["content"]

self.messages.append({"role": "assistant", "content": reply})

return reply

except Exception as e:

return f"服务暂时不可用,请稍后再试:{str(e)}"

# 运行测试

bot = CustomerServiceBot("你的API密钥")

print(bot.talk("老师在吗?"))

print(bot.talk("我需要老师帮我安装学习软件"))

print(bot.talk("小白 大模型 13412341234"))

在实际开发中,我们还可以基于这套交互架构,进一步扩展更多实用功能:比如给AI客服添加知识库检索,让大模型基于自有数据回复;或者接入语音交互,实现语音对话机器人;也可以结合Flask/Django搭建Web服务,把AI客服部署成在线工具。同时,我们也可以参考Python requests官方文档,深入学习HTTP请求的高级用法,让交互更稳定、更高效。

对于新手来说,学习这套技术的最佳路径是:先跑通基础的API调用代码,再逐步实现多轮对话,然后调整参数优化效果,每一步都在Jupyter中验证效果,遇到报错优先排查API密钥、网络连接、依赖库这三个高频问题,就能快速上手,从Python基础顺利过渡到AI应用开发。

图2:Python与大模型交互 实战案例Jupyter运行效果

六、Python与大模型交互:新手避坑指南

避坑1:API密钥错误/泄露

密钥错误会直接返回401无权限,复制时注意不要多空格/换行,严禁将密钥上传到公开仓库。

避坑2:未安装requests库

大模型交互必须依赖requests,先执行 pip install requests,再import使用。

避坑3:缺少异常处理导致崩溃

网络波动、超时、API限流都会报错,必须加try-except保证代码稳定运行。

避坑4:对话历史过长导致token超限

多轮对话需控制历史长度,避免token超出模型上限,可定期清理历史。

避坑5:参数配置不合理导致输出异常

temperature过高会导致内容混乱,max_tokens过小会导致回复截断,需根据场景调整。

七、Python与大模型交互:学习路线与总结

- 入门阶段:掌握环境准备 → 学会基础API调用 → 能实现单轮对话

- 进阶阶段:掌握多轮对话 → 学会参数配置 → 能开发简单对话机器人

- 提升阶段:学习封装优化 → 加入异常处理 → 实现稳定的AI应用

- 精通阶段:对接实际项目 → 结合Python生态 → 开发复杂AI系统

- 核心重点:Python与大模型交互的核心是「API请求+对话管理」,掌握这两点就能实现绝大多数AI应用

- 学习技巧:在Jupyter逐行运行,先跑通单轮对话,再叠加多轮对话与参数,遇到报错优先检查密钥、网络、依赖

- 应用衔接:学会本文内容后,可直接对接智能客服、AI写作、代码助手等项目,快速落地实用工具

延伸学习推荐(Python与AI应用)

学完本文内容,可搭配学习: 封装继承与Python调用大模型(内链)、 Python基础与核心语法(内链)、 Python requests官方文档(外链)。

渝公网安备50022402001073号

渝公网安备50022402001073号